Moondream: 轻量级视觉语言模型,让图像理解更简单

Star

Forks

Watch

Issues

Moondream是一款功能强大的小型视觉语言模型,可在各种平台上运行。它能够理解图像内容并回答相关问题,就像拥有一双“慧眼”一样。

项目介绍

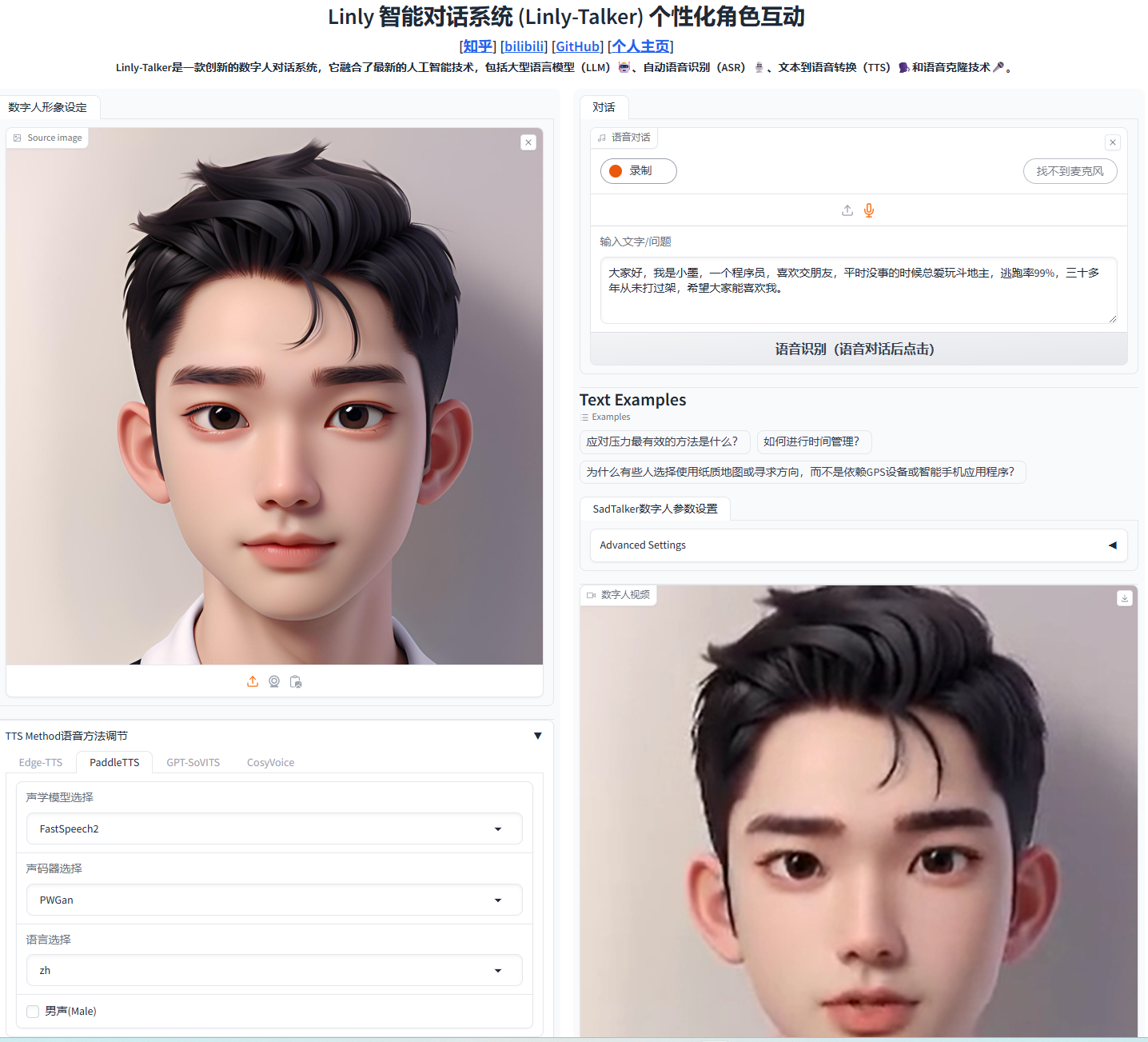

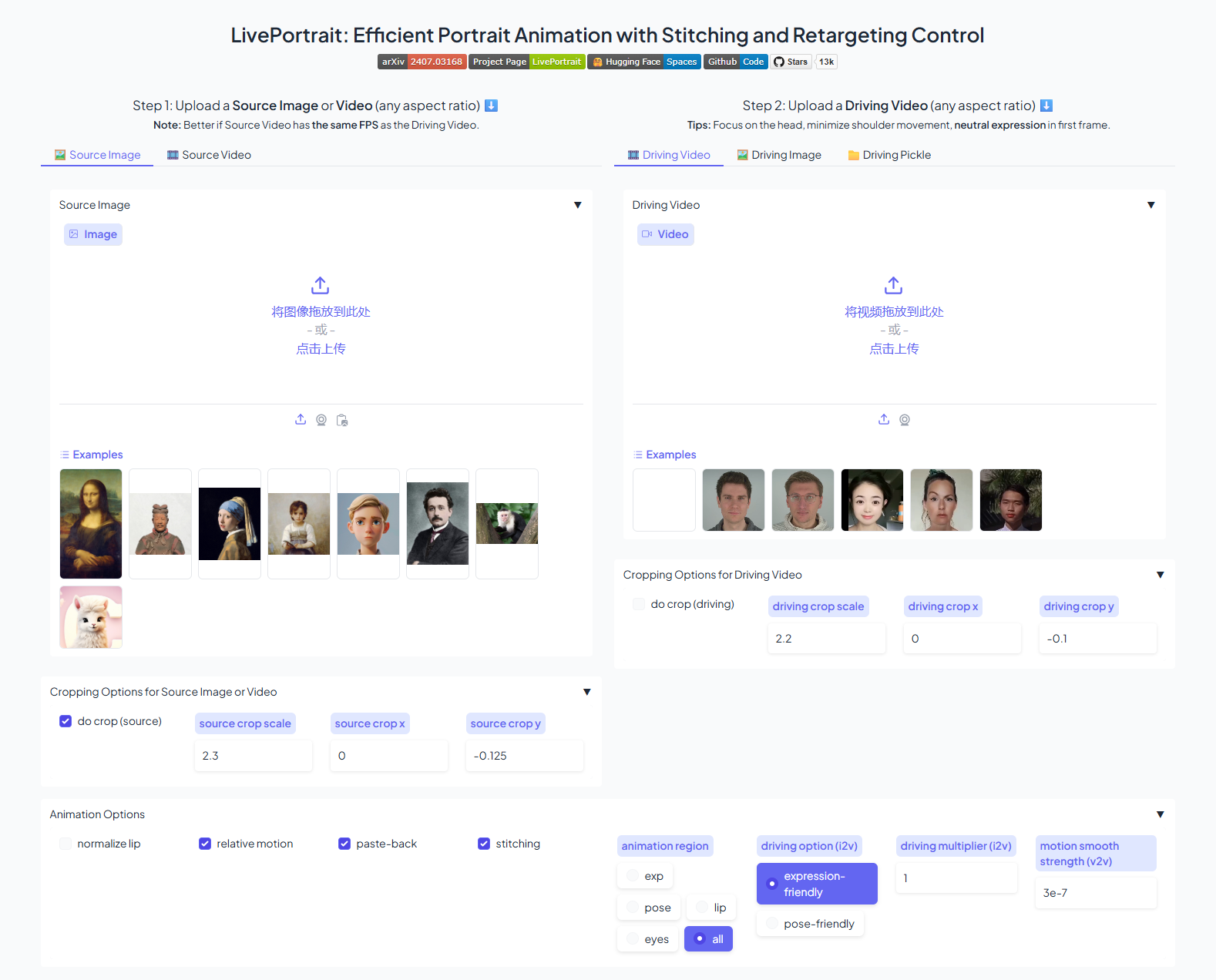

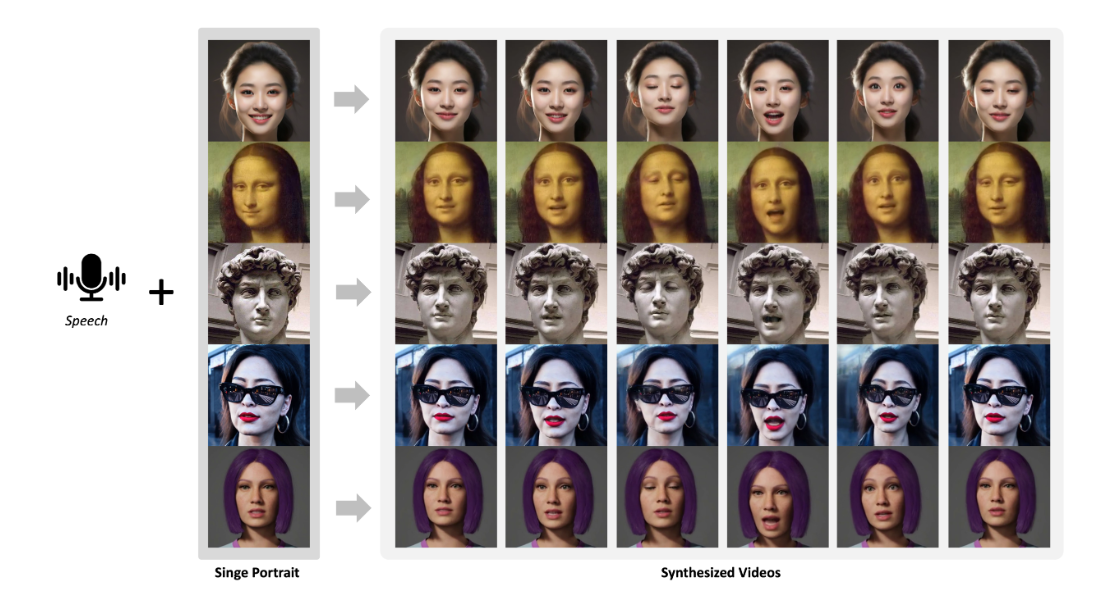

Moondream的核心功能是将图像和文本联系起来。用户可以提供一张图像,并提出相关问题,模型会分析图像内容并给出文本答案。它不仅可以描述图像中的对象和场景,还能理解图像中更深层次的含义,例如人物的动作和情感。 项目提供了多种使用方式,包括通过Hugging Face Transformers库、命令行界面以及Gradio可视化界面。 提供的示例图片和问答展示了Moondream的出色能力,例如准确识别女孩的动作和头发颜色,以及对复杂场景的详细描述。

优势分析

Moondream的主要优势在于其轻量级和易用性。与其他大型视觉语言模型相比,Moondream的体积更小,资源消耗更低,因此更容易在各种设备上部署和使用,即使是普通用户也能轻松上手。 它支持多种使用方式,从简单的命令行交互到可视化的Gradio界面,用户可以根据自己的需求选择合适的方式。 项目持续更新,开发者积极维护,并提供了详细的文档和示例代码,方便用户学习和使用。

使用方法

Moondream 提供了多种使用方法,最推荐的是通过Hugging Face Transformers库调用。 只需要安装必要的库,加载模型和分词器,即可开始使用。 项目提供了清晰的代码示例,演示了如何加载图像、编码、并向模型提问。 此外,项目还支持批量推理,可以同时处理多张图片和多个问题。除了使用Transformers库,用户还可以直接克隆项目仓库,通过命令行或Gradio界面进行交互。

社区和贡献

Moondream项目托管在GitHub上,并已发布到Hugging Face平台。项目拥有活跃的社区,开发者定期更新模型并修复bug。 项目鼓励用户参与贡献,例如提交代码、报告问题或分享使用案例。

总结

Moondream作为一个轻量级的视觉语言模型,为用户提供了一种便捷的方式来理解和分析图像。 它的易用性、高效性和持续的更新使其成为一个值得关注和尝试的项目。未来的发展方向可能包括支持更多类型的图像和问题,以及进一步提升模型的性能和准确性。